de.hideout-lastation.com

de.hideout-lastation.com

10 Web Scraping Tools zum Extrahieren von Online-Daten

Web Scraping-Tools wurden speziell zum Extrahieren von Informationen von Websites entwickelt. Sie werden auch als Web-Harvesting-Tools oder Web-Datenextraktionswerkzeuge bezeichnet. Diese Tools sind nützlich für jeden, der versucht, Daten aus dem Internet zu sammeln . Web Scraping ist die neue Dateneingabetechnik, die kein wiederholtes Tippen oder Kopieren / Einfügen erfordert.

Diese Software sucht manuell oder automatisch nach neuen Daten, lädt die neuen oder aktualisierten Daten und speichert sie für Ihren einfachen Zugriff. Zum Beispiel kann man Informationen über Produkte und deren Preise von Amazon mit einem Schabwerkzeug sammeln. In diesem Beitrag führen wir die Anwendungsfälle von Web-Scraping-Tools und den Top-10-Web-Scraping-Tools auf, um Informationen mit null Codierung zu sammeln.

Anwendungsfälle von Web Scrapping Tools

Web Scraping-Tools können in verschiedenen Szenarien für unbegrenzte Zwecke verwendet werden, aber wir werden einige allgemeine Anwendungsfälle behandeln, die für allgemeine Benutzer gelten.

Sammeln Sie Daten für die Marktforschung

Mithilfe von Web-Scraping-Tools können Sie in den nächsten sechs Monaten auf dem Laufenden bleiben, wo sich Ihr Unternehmen oder Ihre Branche befindet, und als leistungsstarkes Tool für die Marktforschung dienen. Die Tools können von mehreren Datenanalyseanbietern und Marktforschungsunternehmen abgerufen und für eine einfache Referenzierung und Analyse an einem Ort konsolidiert werden.

Kontaktinformationen extrahieren

Diese Tools können auch verwendet werden, um Daten wie E-Mails und Telefonnummern von verschiedenen Websites zu extrahieren, so dass Sie eine Liste von Lieferanten, Herstellern und anderen Personen von Interesse für Ihr Unternehmen oder Unternehmen neben ihren jeweiligen Kontaktadressen haben können.

Laden Sie Lösungen von StackOverflow herunter

Mit einem Web-Scraping-Tool können Sie auch Lösungen zum Offline-Lesen oder -Speichern herunterladen, indem Sie Daten von mehreren Websites (einschließlich StackOverflow und mehr Q & A-Websites) sammeln. Dies verringert die Abhängigkeit von aktiven Internetverbindungen, da die Ressourcen trotz der Verfügbarkeit eines Internetzugangs leicht verfügbar sind.

Suchen Sie nach Jobs oder Kandidaten

Für Mitarbeiter, die aktiv nach mehr Kandidaten suchen, um ihrem Team beizutreten, oder für Arbeitsuchende, die nach einer bestimmten Rolle oder einer freien Stelle suchen, sind diese Tools auch hervorragend zum mühelosen Abrufen von Daten auf der Grundlage verschiedener angewandter Filter geeignet Suchen.

Verfolgen Sie Preise von mehreren Märkten

Wenn Sie Online-Shopping betreiben und es lieben, Preise von Produkten, nach denen Sie suchen, über mehrere Märkte und Onlineshops hinweg aktiv zu verfolgen, dann benötigen Sie definitiv ein Web-Scraping-Tool.

10 besten Web-Scraping-Tools

Werfen wir einen Blick auf die 10 besten Web-Scraping-Tools zur Verfügung. Einige von ihnen sind kostenlos, einige von ihnen haben Probezeiten und Premium-Pläne. Schauen Sie sich die Details an, bevor Sie jemanden für Ihre Bedürfnisse abonnieren.

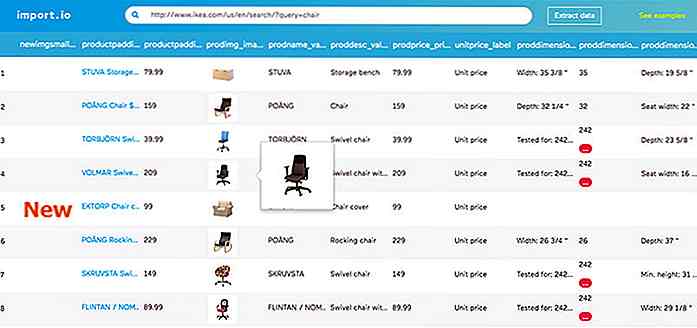

Import.io

Import.io bietet einen Builder zum Erstellen eigener Datensätze, indem einfach die Daten von einer bestimmten Webseite importiert und die Daten in CSV exportiert werden. Sie können in wenigen Minuten Tausende von Webseiten scrappen, ohne eine einzelne Codezeile zu schreiben und 1000+ APIs basierend auf Ihren Anforderungen zu erstellen .

Import.io verwendet Spitzentechnologie, um jeden Tag Millionen von Daten zu sammeln, die Unternehmen für kleine Gebühren nutzen können. Zusammen mit dem Web-Tool bietet es auch kostenlose Apps für Windows, Mac OS X und Linux, um Datenextraktoren und Crawler zu erstellen, Daten herunterzuladen und mit dem Online-Konto zu synchronisieren.

Webhose.io

Webhose.io Webhose.io bietet direkten Zugriff auf Echtzeit- und strukturierte Daten aus Tausenden von Online-Quellen. Der Web Scraper unterstützt das Extrahieren von Webdaten in mehr als 240 Sprachen und das Speichern der Ausgabedaten in verschiedenen Formaten, einschließlich XML, JSON und RSS .

Webhose.io ist eine Browser-basierte Webanwendung, die eine exklusive Daten-Crawling-Technologie verwendet, um große Datenmengen von mehreren Kanälen in einer einzigen API zu crawlen. Es bietet einen kostenlosen Plan für 1000 Anfragen / Monat und einen $ 50 / mth Premium Plan für 5000 Anfragen / Monat.

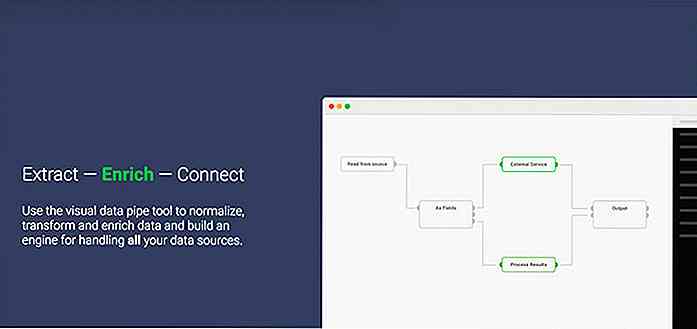

Dexi.io (früher bekannt als CloudScrape)

Dexi.io (früher bekannt als CloudScrape) CloudScrape unterstützt die Datenerfassung von jeder Website und benötigt keinen Download wie Webhose. Es bietet einen browserbasierten Editor zum Einrichten von Crawlern und Extrahieren von Daten in Echtzeit. Sie können die gesammelten Daten auf Cloud-Plattformen wie Google Drive und Box.net speichern oder als CSV oder JSON exportieren.

CloudScrape unterstützt auch den anonymen Datenzugriff, indem eine Reihe von Proxy-Servern zur Verfügung gestellt wird, um Ihre Identität zu verbergen. CloudScrape speichert Ihre Daten für zwei Wochen auf ihren Servern, bevor sie archiviert werden. Der Web-Scraper bietet 20 kostenlose Scraping-Stunden und kostet $ 29 pro Monat.

Scrapinghub

Scrapinghub Scrapinghub ist ein Cloud-basiertes Datenextraktionstool, das Tausenden von Entwicklern hilft, wertvolle Daten abzurufen. Scrapinghub verwendet Crawlera, einen intelligenten Proxy-Rotator, der das Umgehen von Bot-Gegenmaßnahmen zum Crawlen riesiger oder Bot-geschützter Sites unterstützt.

Scrapinghub konvertiert die gesamte Webseite in organisierten Inhalt . Sein Expertenteam steht für Hilfe zur Verfügung, falls der Crawler seine Anforderungen nicht erfüllen kann. Der grundlegende kostenlose Plan bietet Ihnen Zugriff auf 1 gleichzeitige Crawl und der Premium-Plan für $ 25 pro Monat bietet Zugriff auf bis zu 4 parallele Crawls.

ParseHub

ParseHub ParseHub wurde entwickelt, um einzelne und mehrere Websites mit JavaScript, AJAX, Sessions, Cookies und Weiterleitungen zu crawlen. Die Anwendung nutzt maschinelle Lerntechnologie, um die kompliziertesten Dokumente im Web zu erkennen und generiert die Ausgabedatei basierend auf dem erforderlichen Datenformat.

ParseHub steht neben der Web-App auch als kostenlose Desktop-Anwendung für Windows, Mac OS X und Linux zur Verfügung, die einen kostenlosen Basisplan für 5 Crawl-Projekte bietet. Dieser Dienst bietet einen Premium-Plan für 89 $ pro Monat mit Unterstützung für 20 Projekte und 10.000 Webseiten pro Crawl.

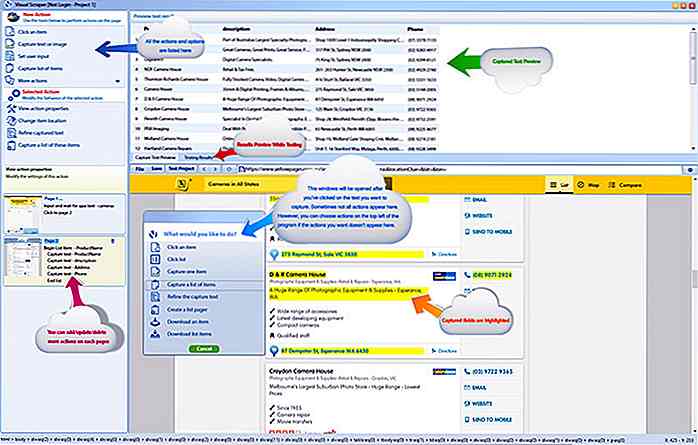

VisualScraper

VisualScraper VisualScraper ist eine weitere Web-Datenextraktionssoftware, mit der Informationen aus dem Internet gesammelt werden können. Die Software hilft Ihnen, Daten von mehreren Webseiten zu extrahieren und die Ergebnisse in Echtzeit abzurufen. Darüber hinaus können Sie in verschiedenen Formaten wie CSV, XML, JSON und SQL exportieren.

Mit der einfachen Point-and-Click-Oberfläche können Sie Web-Daten einfach erfassen und verwalten. VisualScraper ist kostenlos und Premium-Pläne ab $ 49 pro Monat mit Zugriff auf 100K + Seiten. Seine kostenlose Anwendung, ähnlich der von Parsehub, ist für Windows mit zusätzlichen C ++ - Paketen verfügbar.

Spinn3r

Spinn3r Mit Spinn3r können Sie ganze Daten von Blogs, Nachrichten- und Social-Media-Seiten sowie RSS- und ATOM-Feeds abrufen. Spinn3r wird mit einer Firehouse-API vertrieben, die 95% der Indexierungsarbeit verwaltet. Es bietet einen fortschrittlichen Spamschutz, der Spam und unangemessene Sprachverwendungen entfernt und somit die Datensicherheit verbessert.

Spinn3r indiziert ähnliche Inhalte wie Google und speichert die extrahierten Daten in JSON-Dateien. Der Web-Scraper scannt das Web ständig und findet Updates von mehreren Quellen, um Ihnen Echtzeit-Publikationen zu ermöglichen. Über die Admin-Konsole können Sie Crawls steuern und die Volltextsuche ermöglicht komplexe Abfragen von Rohdaten .

80 Legs

80 Legs 80legs ist ein leistungsstarkes und dennoch flexibles Web-Crawling-Tool, das nach Ihren Bedürfnissen konfiguriert werden kann. Es unterstützt das Abrufen riesiger Datenmengen und die Möglichkeit, die extrahierten Daten sofort herunterzuladen. Der Web Scraper beansprucht 600.000+ Domains zu crawlen und wird von großen Playern wie MailChimp und PayPal genutzt.

Mit der " Datafiniti " können Sie die gesamten Daten schnell durchsuchen . 80legs bietet leistungsstarkes Web-Crawling, das schnell funktioniert und die erforderlichen Daten in Sekundenschnelle holt. Es bietet einen kostenlosen Plan für 10K-URLs pro Crawl und kann zu einem Intro-Plan für $ 29 pro Monat für 100 K-URLs pro Crawling aufgerüstet werden.

Schaber

Schaber Scraper ist eine Chrome-Erweiterung mit eingeschränkten Funktionen zum Extrahieren von Daten. Sie ist jedoch hilfreich, um online zu recherchieren und Daten in Google Spreadsheets zu exportieren . Dieses Tool richtet sich sowohl an Anfänger als auch an Experten, die Daten einfach in die Zwischenablage kopieren oder mit OAuth in den Tabellen speichern können.

Scraper ist ein kostenloses Tool, das direkt in Ihrem Browser funktioniert und automatisch kleinere XPaths für das Crawlen von URLs generiert. Es bietet nicht die Leichtigkeit des automatischen oder Bot-Crawlings wie Import, Webhose und andere, aber es ist auch ein Vorteil für Anfänger, da Sie keine unordentliche Konfiguration angehen müssen .

OutWit Hub

OutWit Hub OutWit Hub ist ein Firefox-Add-On mit Dutzenden von Datenextraktionsfunktionen, um Ihre Websuche zu vereinfachen. Dieses Tool kann automatisch Seiten durchsuchen und die extrahierten Informationen in einem geeigneten Format speichern. OutWit Hub bietet eine einzige Schnittstelle, um winzige oder große Datenmengen nach Bedarf zu scrapen.

Mit OutWit Hub können Sie jede Webseite vom Browser aus scrappen und sogar automatische Agenten erstellen, um Daten zu extrahieren und pro Einstellung zu formatieren. Es ist eines der einfachsten Web-Scraping-Tools, das kostenlos verwendet werden kann und Ihnen den Komfort bietet, Web-Daten zu extrahieren, ohne eine einzelne Codezeile zu schreiben.

Welches ist Ihr bevorzugtes Web-Scraping-Tool oder Add-on? Welche Daten möchten Sie aus dem Internet extrahieren? Teilen Sie Ihre Geschichte mit uns über den folgenden Kommentarbereich.

Welches ist Ihr bevorzugtes Web-Scraping-Tool oder Add-on? Welche Daten möchten Sie aus dem Internet extrahieren? Teilen Sie Ihre Geschichte mit uns über den folgenden Kommentarbereich.

So erstellen Sie Ihre eigenen WordPress Shortcodes

Shortcodes sind eine sehr mächtige Funktion von WordPress. Im Wesentlichen ist ein Shortcode ein Platzhalter für andere Inhalte. Ein bekannter Shortcode ist der eingebaute Gallery-Shortcode. Schreib einfach in den WordPress-Editor und es wird durch eine Galerie von Bildern aus Medien auf den Beitrag hochgeladen ersetzt werden.O

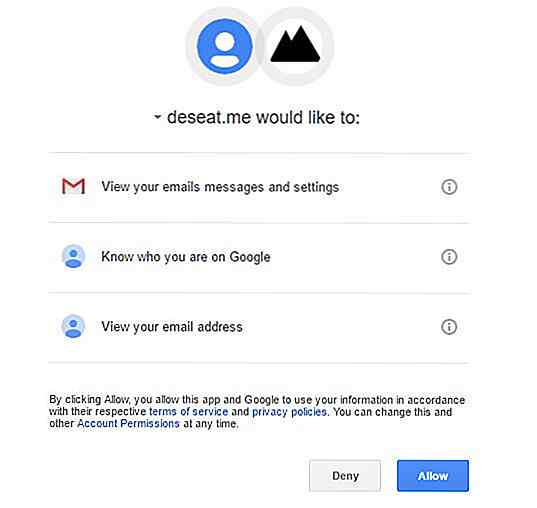

Verfolgen und löschen Sie alle Konten, für die Sie sich mit Deseat.me registriert haben

Es ist eine Herausforderung, die Dienste zu verfolgen, die Sie über die Jahre über Ihr E-Mail-Konto registriert haben. Glücklicherweise gibt es einen Dienst namens Deseat.me, wenn Sie Google Mail verwenden. Sie können Dienste, die mit Ihrem Konto verknüpft sind, verfolgen und in einigen Fällen löschen . Jetzt

![Schöne Tee Verpackungsdesigns [Showcase]](http://hideout-lastation.com/img/tech-design-tips/574/lovely-tea-packaging-designs.jpg)